Extended Music Learning! XR und die Zukunft des Musikunterrichts

28.10.2024: Im Beitrag wird die Integration von Virtual Reality (VR) und Augmented Reality (AR) in den Musikunterricht vorgestellt. Lisa Werner, Tobias Rotsch und Sandro Dalfovo berichten, wie sie in ihren Projekten neue Lehr-Lern-Konzepte erforschen und entwickeln.

Stellen Sie sich eine Musikunterrichtsstunde der nahen Zukunft vor: Sie betreten ein Klassenzimmer, das kaum wiederzuerkennen ist. Am oberen Rand des Zimmers liegen VR-Brillen mit Controllern, Tablets und Kopfhörer auf einzelnen Ablagen bereit. Auf weiteres Mobiliar wird zunehmend verzichtet, damit genügend Platz ist, um sich im Raum zu bewegen. Nachdem Sie die Brille aufgesetzt haben, treffen Sie in einer virtuellen, computersimulierten Umgebung als Avatar auf andere Teilnehmende, und begeben sich gemeinsam auf eine Reise in die Musikgeschichte: Sie haben die Möglichkeit, den Komponistinnen und Komponisten der jeweiligen Epoche über die Schulter zu schauen, entdecken die Umgebung, in der sie aufgewachsen sind, hören ihre Musik und experimentieren am Ende selbst damit.

| Prompt von Abbildung 1: Foto von Kindern im Musikunterricht, die zur Größe des Kopfes proportional passende VR-Headsets tragen, im Musikraum gemeinsam Musizieren und dabei Spaß haben. |

Zukunft als Impulsgeber

Zukunftsforscherinnen und Zukunftsforscher sind sich einig, dass nicht nur Künstliche Intelligenz, sondern auch Virtual, Augmented und Mixed Reality zum Lebensalltag der nahen Zukunft zählen werden: „Im Zuge des technologischen Wandels wird insbesondere VR-Medien (Virtual-Reality-Medien) das Potenzial zugesprochen, den Lernerfolg von Schüler:innen zu steigern und ein konstruktivistisches Lernen zu fördern.“ (Hellriegel & Dino Čubela, 2018, S. 58) Neue Formen der Interaktivität, Exploration und Erlebnismöglichkeit im dreidimensionalen Raum können zentrale Schlüsselkompetenzen wie das vernetzende Denken und autonome Lernkompetenzen fördern. Damit einher geht das große Potential einer dynamischen Unterrichtsgestaltung (Conrad Electronic SE, 2021). VR-bezogene Apps ermöglichen es Schülerinnen und Schülern schon jetzt, in virtuellen Umgebungen gemeinsam zu musizieren oder ihre eigenen Musizierumgebungen und Producing-Setups zu gestalten (vgl. Tabelle für Erläuterungen).|

|

AR (Augmented Reality) AR wird besonders für Smartphones und Tablets entwickelt, in der App Minibeats (im Bild links) spielt man mit der eigenen Hand ein Instrument, das in die reale Umgebung via Smartphone projiziert wird. Bei Songs Of Cultures sind es verschiedene Musik-Charaktere (im Bild rechts). |

|

|

VR (Virtual Reality) So bietet die Anwendung Virtuoso beispielsweise die Möglichkeit, mithilfe der zugehörigen Hardware-Controller ein Schlagzeug in einer virtuellen Umgebung zu spielen. Wie für VR typisch, erfolgt für eine möglichst hohe bewegungsbezogene Realitätsnähe die Interaktion mit dem computergenerierten Schlagzeug durch die Nachahmung einer echten Schlagbewegung. Neben der Möglichkeit eines freien Spielens bietet die App auch die Option, rhythmische Patterns vorzugeben und dem Nutzenden durch dynamisch farbliche Darstellungen anzuzeigen, wann welche Elemente des Drumsets gespielt bzw. „geschlagen“ werden sollen. So kann auch das rhythmische Spiel zu fertigen Songs trainiert werden. |

|

|

MR (Mixed Reality) Die Klavierlern-App PianoVision nutzt die Mixed Reality, um Lernenden einen bequemen und erfolgsversprechenden Einstieg in das Klavierspiel zu ermöglichen. Mit der Option, das eigene Piano von den Außenkameras der VR-/MR-Brille erfassen zu lassen und die Tastatur nach einer kurzen Kalibrierung als Referenz für das Einblenden nützlicher Inhalte (z.B. Tastennamen, siehe Abbildung links) zu nutzen, erhält der Anwender oder die Anwenderin genaue Informationen darüber, welche Tasten zu welchem Zeitpunkt gedrückt werden müssen. Die Musizierenden sehen dann mehrere, aus der Raumtiefe auf sich zukommende Balken, die jeweils einer bestimmten Taste auf dem Klavier zugeordnet sind. Sobald der Balken die Taste erreicht, muss diese betätigt werden, sodass in der richtigen Reihenfolge ein Lied erklingt. |

Solche Szenarien sind heute schon in Ansätzen möglich:

Das Spiel Patchworld (Abb. 2) des schweizerisch-dänischen Studios PatchXR bietet beispielsweise eine umfangreiche Bibliothek an Werkzeugen und ungewöhnlichen Instrumenten, die es den Spielenden ermöglichen, eigene Musik zu komponieren und audiovisuelle Welten aus virtuellen Musikinstrumenten, Producing Tools, visuellen Elementen und Räumen zu gestalten. Patchworld ist als eine Plattform konzipiert, die als Kreativwerkstatt und, im Multiplayer Modus, auch als sozialer Treffpunkt funktioniert. Selbst erstellte Klänge und Produktionen können geteilt oder die Kreationen anderer erkundet werden. Sobald man aus einer Vielzahl von virtuellen Instrumenten wie Synthesizern, Drum Machines und ungewöhnlichen Klangobjekten wie Gummienten oder Flaschen seine Favoriten ausgewählt hat, steht einer gemeinsamen Jam-Session mit anderen Teilnehmenden nichts mehr im Wege. Die so entstehenden kreativen Prozesse gestalten die Spielenden als virtuelle Avatare. Musik lässt sich hierbei auf eine einzigartige, spielerische und innovative Weise erleben und gestalten.

Weitere Anwendungen aus den vergangenen Jahren, wie Schumann VR oder Konzerthaus Plus erlauben die Erkundung kultureller, musikalischer und geschichtlich bedeutsamer Wirkungsstätten. Schülerinnen und Schüler können vor Ort in AR- und VR-Anwendungen mit unterschiedlichen thematischen Schwerpunkten eintauchen. Auch für das zu Beginn aufgeführte „Klassenzimmer-Szenario“ findet man bereits erste Umsetzungen: So ermöglicht es das gemeinnützige Bildungsprojekt beethoven opus 360 im Rahmen von bis dato großflächig angelegten Schultourneen in Deutschland, der Schweiz und Österreich, dass sich VR, Rap, Gaming und klassische Musik zu einer innovativen und mobilen Musikvermittlung verbinden, „die einen neuen Zugang zu dem Werk und Leben Ludwig van Beethovens eröffnet – ohne jegliche Vorkenntnisse oder musikalische Vorbildung.“ (Agon e.V.,2023)

Die Zukunft des Musiklernens im Fokus: Die Projekte LEVIKO-XR und KuMuS-ProNeD

Die Teilprojekte unter Leitung von Prof. Dr. Philipp Ahner am Standort der Staatlichen Hochschule für Musik Trossingen im Rahmen der Verbundprojekte KuMuS-ProNeD und LEVIKO-XR sind Teil von lernen:digital. Die beiden EU & BMBF geförderten Projekte setzen sich in ihrer Laufzeit von Juli 2023 bis Februar 2026 mit dem Einsatz digitaler Technologien im Musikunterricht und der Entwicklung damit zusammenhängender Unterrichts- und Fortbildungskonzeptionen auseinander.

Die Projekte verfolgen das Ziel, die aktuellen Entwicklungen nicht hintenanzustellen, sondern heute schon den Einsatz dieser Technologien im Musikunterricht kritisch zu hinterfragen, zu begleiten und deren Möglichkeiten und Grenzen aufzuzeigen.

Wegweisend für den Prozess der Entwicklung von Lehr-Lern-Designs sind hierbei unter anderem verschiedene Kernfragen: Welche Themen und Lernziele eignen sich besonders gut für den Einsatz der Technologien? Wie können die musikbezogenen XR-Inhalte nachhaltig in den Musikunterricht integriert werden, sodass brauchbare Zusammenhänge zu den relevanten Themenbereichen und Handlungsfeldern entstehen? Wie können die Potentiale und Grenzen von allen beteiligten Akteurinnen und Akteuren anhand eigener Praxiserfahrungen nachvollzogen werden?

Sowohl LEVIKO-XR als auch KuMuS-ProNeD gestalten ihre Untersuchungen und Szenarien auf Basis bereits vorhandener Apps für VR-/MR-Headsets. Diese wurden zunächst als Grundlage für weitere Konzeptionen in Voruntersuchungen erforscht. Folgende mögliche Themenbereiche e und Handlungsfelder als besonders relevant für das Fach Musik identifiziert:

- Kreieren und Produzieren,

- Musizieren und Improvisation,

- Hörerfahrung (Rezeption, Akustik),

- Musik und Bewegung (rhythmische Spiele) sowie

- theoretische Inhalte (zum Beispiel zum Themenfeld Musikgeschichte, siehe Beginn des Beitrags).

Auch interdisziplinäre Möglichkeiten und Verbindungen zu Nicht-Musik-Apps gehören zu den ersten grundlegenden Bereichen, zu denen nun in den beiden Projekten konkrete Lehr-Lern-Designs entwickelt werden. Das verwendete Design-Based-Research Verfahren dient dabei als theoretische Basis, um unter Einbezug didaktischer Modelle wie u. a. TPACK praxisorientiert bei der Konzeption und (Weiter-) Entwicklung vorzugehen.

Die oben aufgeführten Themenbereiche zeigen das breite Potential von XR-Technologien im Musikunterricht, da mit ihnen mehrere relevante Kompetenzbereiche aus dem Bereich Musik adressiert werden. Mit Analysen der User-Experience und der Aufstellung didaktischer Kriterien und Ziele werden nun die Anwendungen in ihrer Breite für konkretere Erprobungszyklen praxisorientiert in den Projekten ausgearbeitet, dokumentiert und im weiteren Projektverlauf veröffentlicht.

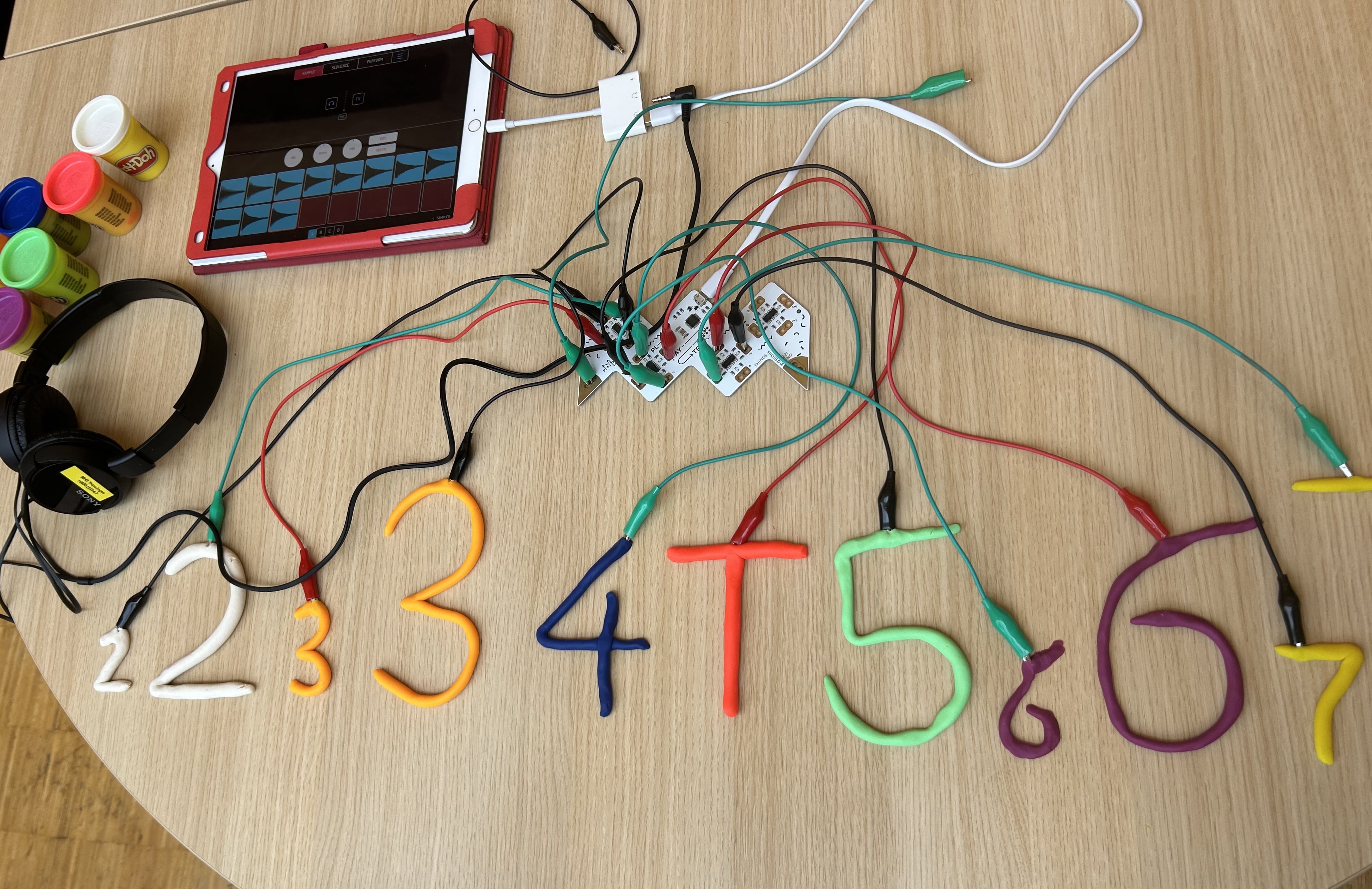

Das Vorgehen mit Design-Based-Research lässt sich darüber hinaus auch auf andere, jüngere Technologien übertragen. Insbesondere das Projekt KuMuS-ProNeD ergründet die Möglichkeiten der MIDI-Controller Touch me und Playtron von Playtronica.

Diese Technologie erlaubt es, mit stromleitenden Objekten Musik zu erfinden bzw. die „Intensität der Berührung zwischen Menschen“ (Playtronica, 2016) in Töne umzuwandeln (vgl. Abb.3). Vielversprechende Möglichkeiten zum Musiklernen mit Bewegung, durch Improvisation und über Musiktheorie wurden bereits in Voruntersuchungen mit Studierenden untersucht und auf der auf der European Association for Music in Schools-Conference 2024 präsentiert (Werner, Rotsch & Ahner, 2024). Abbildung 3 zeigt die Arbeit eines Studierenden, der ein mögliches Setup im Kontext von Playtron erarbeitet hat, um Schülerinnen und Schülern die Intervalle optisch, haptisch und auditiv näher zu bringen. Solche und viele weitere denkbare Setups im Kontext von Playtronica und auch XR-Technologien ermöglichen hierbei neue, niedrigschwellige Zugänge zum Musiklernen. Sie können mit Blick auf ihr gestalterisches Potential, die flexible Anwend- und Einsetzbarkeit und den hohen Alltagsbezug zu einer engagierteren und motivierteren Begegnung mit dem Fach Musik für verschiedene Zielgruppen beitragen.

Zukunftsperspektiven

XR-Technologie kann für wichtige Faktoren des schulischen Musikunterrichts wie Interaktivität, Teilhabe, Produktion oder Zusammenarbeit eine belebende Komponente sein und das Repertoire des digitalen Unterrichts erweitern. Wer schon einmal eine virtuelle Umgebung besucht hat, wird wahrscheinlich mit der Erfahrung konfrontiert worden sein, dass das Erlebte dort auf andere, spezielle Art und Weise empfunden und gespeichert wird. Die Lernpotenziale im Umgang mit virtuellen Dingen, Räumen und Personen herauszuarbeiten, stellt ein zentrales Ziel in den kommenden (Projekt-) Jahren für LEVIKO-XR und KuMuS-ProNeD dar.

Die Beteiligten bewegen sich in diesem Kontext in einem Spannungsfeld zwischen Möglichkeit und Herausforderung: Digitale Werkzeuge werden schon seit einiger Zeit als Mittel anerkannt, um die Begeisterung für das Fach Musik zu entfachen. Der technologische Fortschritt zwingt jedoch dazu, bestehende Konzepte und Designs immer wieder zu überdenken oder anzupassen und neue Wege zu finden, Technologien in den Musikunterricht einzubinden.

Die Projekte LEVIKO-XR und KuMuS-ProNeD blicken positiv auf diese Herausforderungen. Besuchen Sie die Webseiten der beiden Projekte, um weiter zu verfolgen, wie sie einen Beitrag zur Weiterentwicklung der Themenfelder rund um Zukunftstechnologien wie XR im Schulkontext leisten:

Leviko-xr.deTakeaways

Lebensweltbezug: Der Einsatz digitaler Technologien wie XR im Musikunterricht ermöglicht unter anderem niedrigschwellige Zugänge zum musikalischen Experimentieren mit ungewöhnlichen Klangobjekten, hautnahe Konzerterlebnisse oder immersive Zeitreisen zu Komponistinnen und Komponisten vergangener Epochen. So werden in praktischen und theoretischen Themenfeldern des Musikunterrichts neue Potentiale entfacht.

Musikunterricht der Zukunft: Der Prozess der Integration von XR-Technologien in Bildungskontexte wie dem Musikunterricht hat gerade erst begonnen. Es ist daher essenziell, „(angehenden) Lehrkräften derartige grundlegende Erfahrungen und Explorationsmöglichkeiten zu ermöglichen“ (Voit & Heye 2022, S. 43), um den zukunftsgerichteten Einsatz der Technologie im Musikunterricht mit der Praxis zusammen zu entwickeln.

Über die Autorinnen und Autoren

Lisa Werner ist als wissenschaftliche Mitarbeiterin im Projekt KuMuS-ProNeD am Standort der Staatlichen Hochschule für Musik Trossingen tätig. Zuvor absolvierte sie ein 1. Staatsprüfung im Bereich Grundschullehramt mit den Fächern Musik und Englisch und drei Master in den Bereichen Klassenmusizieren, Musikvermittlung und Extended Music Education. Zudem ist sie derzeit Doktorandin im Fach Musikpädagogik und Leitung der Musikvermittlungsabteilung in der Rheinischen Philharmonie Koblenz.Tobias Rotsch ist wissenschaftlicher Mitarbeiter im Projekt LEVIKO-XR am Standort der Staatlichen Hochschule für Musik in Trossingen. Nach seinem Studium an der Musikhochschule Münster im Hauptfach Keyboards & Music Production ist er seit 2007 als Dozent in der Lehre sowie in der Fort- und Weiterbildung im Schnittfeld von Musikpädagogik, Digitalität und Praxis tätig.

Sandro Dalfovo ist als wissenschaftlicher Mitarbeiter im Projekt LEVIKO-XR an der Hochschule für Musik Trossingen tätig. Nach abgeschlossenem Lehramtsstudium (mit Virtual Reality als essenziellem Kernelement seines Examens) und dem Master of Music im Hauptfach Klavier verfolgt er darüber hinaus die Tätigkeit als Konzertpianist.

Die Projekte KuMuS-ProNeD und LEVIKO-XR am Standort der Staatlichen Hochschule für Musik Trossingen stehen unter der Projektleitung von Prof. Dr. Philipp Ahner

Weiterführende Literatur zum Nachlesen

- Werner, L. & Rotsch, T. & Ahner, P. (2024). Learning Music with Playtronica. 10.13140/RG.2.2.33051.07205.

Dieser Beitrag ist auch im lernen:digital-Zukunftsraum erschienen. Er wurde gemeinsam mit Redaktionsteam des Zukunftsraums betreut.

Sofern nichts anderes angegeben wurde, stehen die

Inhalte dieser Seite unter der Lizenz

Creative Commons Namensnennung - Weitergabe unter gleichen Bedingungen 4.0 International.

Verlinkte Inhalte sind von der Lizenz unberührt.

Unter Beachtung der Lizenzbedingungen ist es gestattet,

die Inhalte der Seite zu vervielfältigen, zu verbreiten und

öffentlich zugänglich zu machen, sofern dabei

die beteiligten Autorinnen und Autoren (hier:

Sandro Dalfovo,

Tobias Rotsch,

Lisa Werner)

und schule-mal-digital.de genannt werden und die Verarbeitung und Weitergabe an Dritte wiederum zu diesen Bedingungen erfolgt.

Sofern nichts anderes angegeben wurde, stehen die

Inhalte dieser Seite unter der Lizenz

Creative Commons Namensnennung - Weitergabe unter gleichen Bedingungen 4.0 International.

Verlinkte Inhalte sind von der Lizenz unberührt.

Unter Beachtung der Lizenzbedingungen ist es gestattet,

die Inhalte der Seite zu vervielfältigen, zu verbreiten und

öffentlich zugänglich zu machen, sofern dabei

die beteiligten Autorinnen und Autoren (hier:

Sandro Dalfovo,

Tobias Rotsch,

Lisa Werner)

und schule-mal-digital.de genannt werden und die Verarbeitung und Weitergabe an Dritte wiederum zu diesen Bedingungen erfolgt.